Menlo Ventures 對人工智慧安全未來的願景有哪些?|專家論點【Howie Su】

作者:Howie Su(產業分析師)

人工智慧帶來的威脅與日遽增

正如雲端平台迅速擴展以提供企業運算基礎設施一樣,Menlo Ventures認為現代人工智慧堆疊遵循與公有雲平台相同的成長軌跡和價值創造潛力,這家創投公司認為,當前使用的基礎人工智慧模型與公有雲服務的早期高度相似:結合人工智慧和安全對於使不斷發展的市場發揮其市場潛力相當重要。一個比喻是,這些基礎模型非常類似於我們現在所熟悉的公有雲,例如 AWS 和 Azure,但在 12 到 15 年前,當基礎設施即服務層剛起步時,你看到的是在新基礎建立後產生的巨大價值創造,因此,未來大型語言模型的成長空間還很大。

但從安全的角度來看可能就不是那回事了,使用現有工具保護模型(包括大型語言模型)的安全是不可能的,這會在企業中造成信任差距,並減緩生成式人工智慧的採用,攻擊者利用基於人工智慧的技術來提高其間諜技術,從而擴大信任落差,用人工智慧攻擊人工智慧的技術正在快速發展,但在資安的應用上有待加強,這進一步凸顯企業越來越擔心輸掉人工智慧安全戰爭的原因。事實上,無法保證的投資回報率、資料藏在難以發現的角落,以及企業資料難以與人工智慧一起使用的看法是安全使用生成式人工智慧的三大障礙。

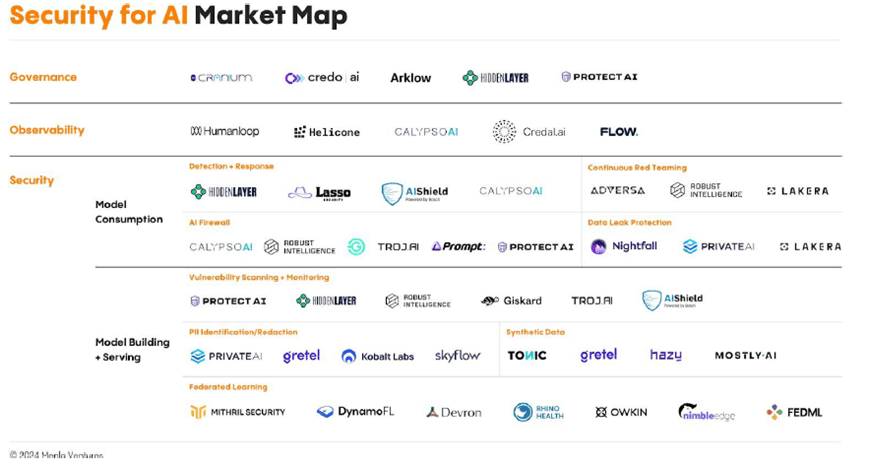

人工智慧治理工具正在努力趕上需求

即便如此,治理工具正快速成長,Menlo Ventures 認為可觀測性工具對於監控模型至關重要,同時也為企業提供了聚合存取、輸入和輸出日誌的能力,這些工具的目標是檢測誤用並提供全面的可審核性。舉例而言,Credo 和 Cranium 等治理工具可協助企業追蹤人工智慧服務、工具和擁有者,無論它們是內部公司還是外部公司製造的,能對安全和保障措施進行風險評估,幫助業者找出企業面臨的風險。確保公司中的每個人都知道如何使用人工智慧是保護大型語言模型 (LLM) ,這也是目前最重要的事情之一。

Menlo Ventures 對人工智慧防火牆提供者特別感興趣,包括Robust Intelligence和Prompt Security,它們可以調節輸入和輸出的有效性、防止即時注入並檢測個人識別資訊 (PII)/敏感資料。其他有興趣的公司包括Private AI和Nightfall,它們幫助組織識別和編輯來自輸入和輸出的 PII 資料。其他有興趣的公司包括Lakera和Adversa,旨在自動化紅隊活動,以幫助組織調查其護欄的穩健性。除此之外,Hiddenlayer和Lasso Security等用於偵測攻擊 LLM 的異常和潛在惡意行為的威脅偵測和回應解決方案也令人感興趣。用於聯邦學習的DynamoFL和FedML,用於生成合成數據的Tonic和Gretel,以降低向 LLM 提供敏感數據的擔憂。

就台灣業者來說,今年一系列的選舉、生成式人工智慧的採用、企業海外佈局設廠的因素都牽涉到潛在資安危機,人工智慧與機器學習正在增加網路攻擊的頻率和複雜性,魏公司帶來新的壓力,這項技術可以讓網路犯罪分子發動複雜而隱密的攻擊,例如深度偽造或自我進化的惡意軟體,從而大規模破壞系統。業者或可從資安地圖上尋找合作解決方案商來強化自身資安防禦能力。

瀏覽 337 次