眼見不為憑!AI詐騙連視訊都能,怎麼分辨真假?|專家論點【朱楚文】

作者:朱楚文(IC之音竹科廣播《科技領航家》主持人)

上一篇文章提到AI網紅爆紅案例,賺得比真人網紅甚至明星還多,這一篇要來談談當虛實難辨時,勢必會衍生的越來越嚴重的問題:AI詐騙。

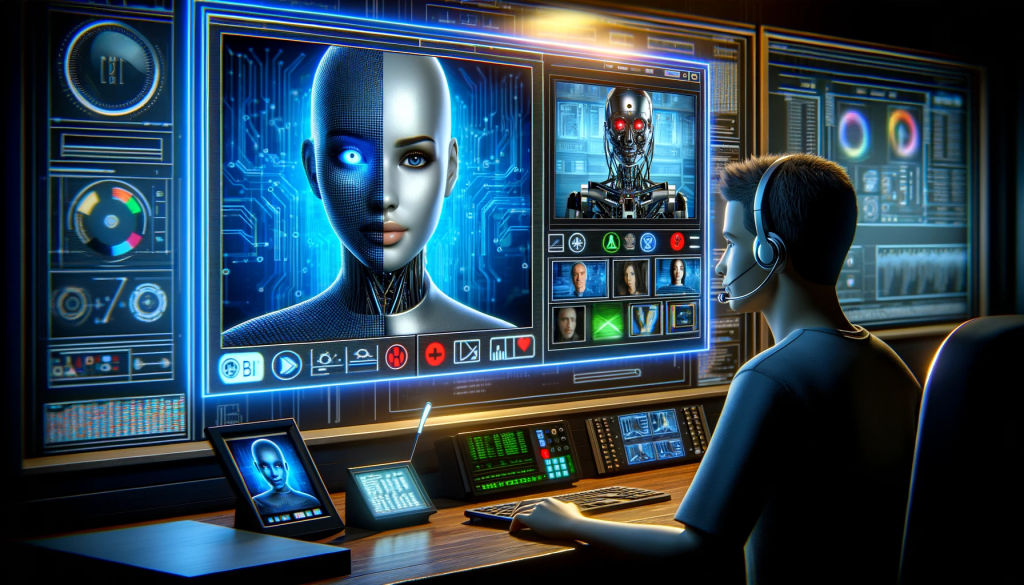

生成式AI讓詐騙更加真假難分,這或許大家已經逐漸有意識,不過你可能以為還只有圖片與聲音,事實上是現在AI生成影像的詐騙才是令人難防。

前陣子有新聞,周湯豪的粉絲被AI版假周湯豪詐騙了50萬台幣,在這一宗詐騙案例中,已不只是慣用的加Line群組聊天,而是假周湯豪直接打電話給粉絲!試想,當你心愛的偶像打視訊電話給你,模樣真實出現在你眼前,你會不會真的很難分辨、容易相信?

這位粉絲於是就相信假周湯豪說律師小孩需要錢看醫生,於是匯款50萬台幣才驚覺詐騙。而在香港,甚至有不法分子運用AI換臉程式Deepfake,冒充報失身分證的市民,瞞過金融機構的人臉辦析系統,騙取7萬元港幣貸款。想想真的不可思議吧!

這也難怪在創新工廠李開復先生的AI 2041這本書中,特別提到未來的一個場景是:人人出門都會帶面具,因為當不法分子可以擷取到你的面容,就可以生成各種虛擬詐騙,保護臉會成為我們的日常!

但對於已有大量聲音節目或影像在網路上的公眾人物來說,實在是很難保護自己,畢竟已有太多公開素材可能被拿去冒用,就如周湯豪的例子,他也是有夠衰,所以除了希望政府盡快執法和想方法杜絕之外,也提醒各位如果有任何你追蹤的公眾人物、偶像、KOL主動聯繫你,不管是聲音或影像,都要記得存疑,特別是如果涉及匯款大量金額,請務必當心詐騙。

另外,現在也出現仿照小孩聲音詐騙父母的案例,各位也要特別當心。聽聞已有不少公司開始對內宣導防範AI詐騙,我先前在節目中訪談Gogolook的經理,他也分享幾招防範之道:

1. 問關鍵問題:簡單來說,就是問通關密語,你可以問一些比較私密的問題,把自己想像成銀行在確認對方身分一樣,例如詢問國小唸哪?以前養的狗叫什麼名字?某個親戚現在住哪?以此確認對方是不是假AI仿照。

2.多方確認:假設遇到熟悉親友聲音或影像來電,聽完內容後,不要立刻相信,請記得打電話回去給本人做確認,或是多方確認內容,避免受騙。

在生成式AI爆發的時代,彭博社報導,今年全球詐騙和網路犯罪,已造成8兆美元損失,金額甚至超過日本GDP!換句話說,古人那一句:眼見為憑,恐怕不再適用,面對以假亂真的詐騙趨勢,我們只能多費點力,不要讓自己的善良成為惡者宰殺的犧牲。

瀏覽 1,691 次