改變人工智慧運算格局 普林斯頓大學開創AI晶片

編譯/高晟鈞

美國國防高級研究計畫局(DARPA)宣布將撥款1860萬美元,用於支持來自普林斯頓大學的電機與電腦工程教授Naveen Verma的專案,該項目的總募資金額可能到達7800萬美元,用於開發人工智慧的先進微晶片。此外,Verma教授也將與新創公司EnCharge AI合作,實現該技術的商業化。

人工智慧的限制

從筆記型電腦、手機再到醫院、高速公路和地球軌道等,為當今最先進模型提供動力的晶片類型過於龐大且效率低下,無法在小型設備上運行,並且主要局限於伺服器和大型資料中心。

資料來源: 打造自己的AI晶片!Sam Altman 與台積電談 AI 晶片合作

「最好的人工智慧僅存在於資料中心。但我認為,如果解鎖了它,我們將徹底改變人工智能領域。」Verma教授說道。

此外,EnCharge AI領導者之一的Kailash Gopalakrishnan表示,當人工智慧開始對運算能力和效率產生大量需求時,現有運算架構的創新以及矽技術的改進將逐漸開始放緩。因為即使是用於運行當今人工智慧系統的最好的圖形處理單元(GPU),也無法緩解行業面臨的記憶體和計算能源瓶頸。

「儘管GPU是現今最好的可用工具,但我們知道,需要一種新型晶片來徹底釋放人工智慧的潛力。」Kailash總結道。

創新的AI晶片技術

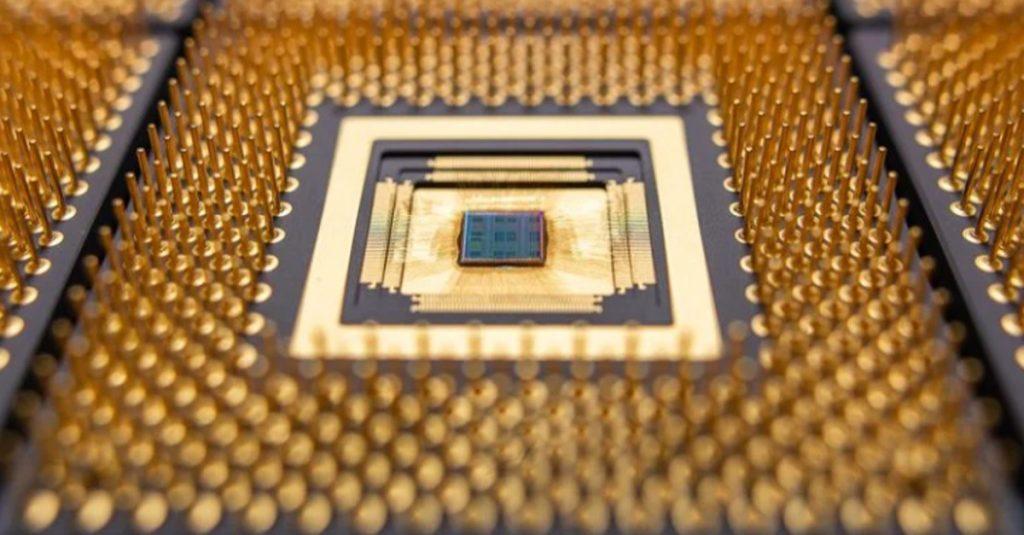

為了製造能夠在小尺寸或能源受限的環境中處理現代人工智慧工作負載的晶片,研究人員必須完全重新構想計算的物理原理,設計出可以套用現有技術直接製造,並且與現有計算技術配合的硬件,例如中央處理單元(CPU)。

對此,他們將計畫分為三個關鍵部分。

傳統電腦的核心架構,將儲存數據以及進行計算的地方分開,這意味著資料需要在處理器與儲存單元中不停傳輸資料。對此,在過去十年中,Verma已成功地直接在記憶體單元中完成計算,減少了移動和處理大量資料所需要的時間和能源成本。這是第一階段:記憶體運算。

然而到目前為止,記憶體運算的依舊存在許多限制;因此,Verma教授與其團隊轉而將精力投注在另應種方法──類比計算(Analog Computing),也是該計畫的第二部分。

早從1940年代開始,數位信號便開始取代類比訊號,以便於二進位被大量使用。然而,相對於傳統電腦使用0與1的二進位,類比計算更多地使用設備本身的物理特性:齒輪的曲率、電線保持電荷的能力來進行信息處理。儘管類比計算透過設備的固有物理特性,它得以處理更精細的訊號來處理效率,但可能會犧牲精度;因此,一切關鍵在於找到適合的材料物理特性。

第三種方法,在於使用具備特殊設計開關的電容器所產生的類比訊號來進行高精度運算。與電晶體不同,透過電容器傳輸的電能不依賴材料中的溫度和電子遷移率等可變條件,關鍵在於「幾何形狀」,更簡單的來說,是兩個金屬線之間的空間。而這對於當今最先進的半導體技術來說,是十分簡單的一件事。

資料來源:SciTechDaily

瀏覽 392 次