Google最新多模態VideoPoet 可完成各種影片生成任務

記者/竹二

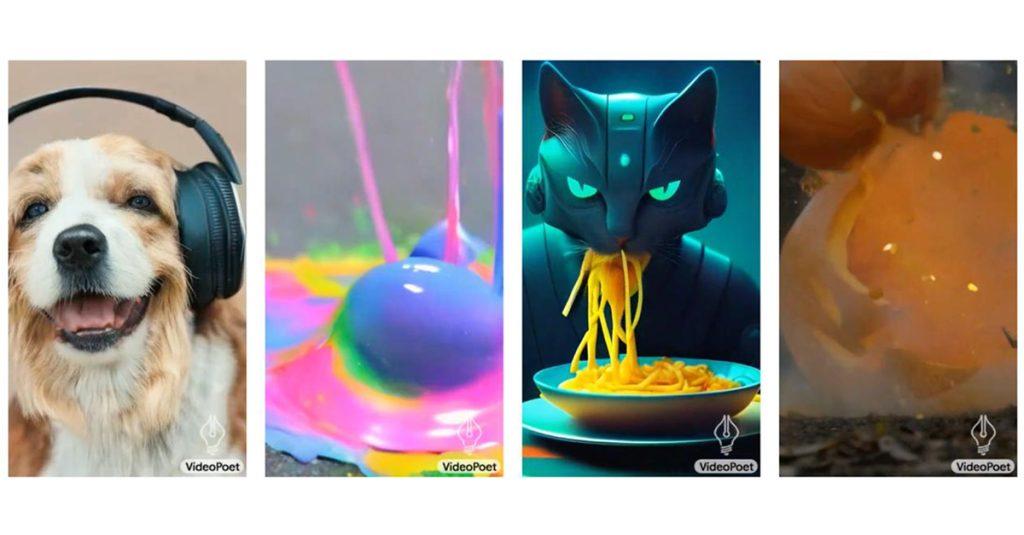

Google近日公佈了最新多模態大型語言模型VideoPoet,有別於當前影片生成模型大多為擴散模型,VideoPoet能夠執行各種影片生成任務,包含文字轉影片、圖片轉影片、影片風格化,甚至是影片轉音訊等,可以完成各種影片生成任務產出高品質影片,單一模型就可生成影片與配樂。

VideoPoet可處理影片、圖像,適應短影片

根據Google的說法,目前最先進的影片生成模型也只能生成小幅度的動作,在生成大動作的時候,就會出現明顯的破綻,因此他們開發出VideoPoet,這是一個能夠執行各種影片生成、任務的大型語言模型,可以把影片生成能力整合到單一大型語言模型中,而不再是仰賴各項針對性任務訓練的獨立元件。

更多新聞:免程式碼、內部搜尋引擎!Gemini與Vertex AI整合超強大

VideoPoet藉由使用多種標記器,可以學習處理影片、圖像、音訊和文字等不同模態,根據特定上下文條件生成相對應的標記後,這些標記就可以透過標記器轉換回可查看的表示形式,生成影片和音訊內容。此外,VideoPoet也適應短影片格式預設生成縱向影片,在進行影片風格化時,能夠預測光流及深度資訊,同時也可以生成音訊,透過先從模型生成的音訊片段,就可在沒有文字指引的情況下,預測接下來的音訊。

VideoPoet可預測接下來的影片,還可互動編輯

VideoPoet能以前一秒的影片預測接下來的影片,以連續預測的方式達到生成更長影片的目的,這種方法不只可以有效延長影片,經過多次迭代後仍能保持影片主體的外觀不變,且生成的影片能夠以互動的方式編輯,像是改變影片中物體的運動,好執行不同的動作,使用者也可以透過文字提示,添加需要的攝影機運動方式,藉此精確控制攝影機的移動。

研究人員表示,VideoPoet的研究貢獻在於展示大型語言模型的能力,同時具有生成高度競爭力影片的能力,特別是在高品質的動作表現方面,未來研究框架會朝向支援任意形式生成任意形式內容的方向發展。

瀏覽 4,585 次