史丹佛大學:程式碼生成 AI 可能產生安全漏洞

編譯/莊閔棻

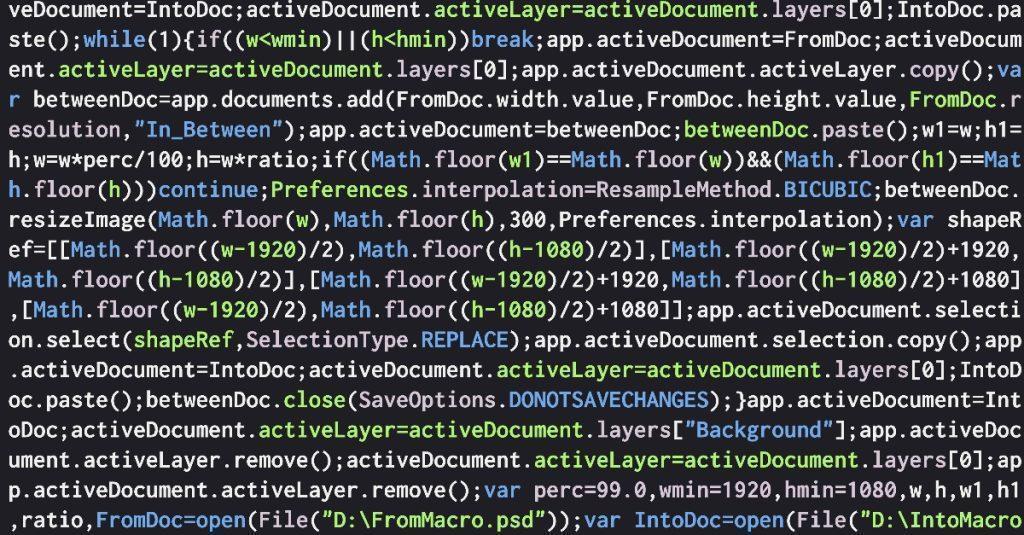

最近的一項研究發現,使用程式碼生成的人工智慧系統的軟體工程師,更有可能在他們開發的應用程式中造成安全漏洞。

根據《TechCrunch》的報導,隨著GitHub 等供應商開始認真地營銷可以自動生成人工智慧的程式碼工具,史丹佛大學的研究人員團隊就表示,程式碼生成系統存有潛在缺陷。研究員Neil Perry說,程式碼生成系統還不能替代人類開發人員,而那些使用它們來加速他們工作的開發人員應該仔細檢查其輸出內容。

史丹佛大學的研究特別專注於由 OpenAI 開發的人工智慧程式碼生成系統Codex的安全問題。雖然說,為了根據現有程式碼的上下文自動產生程式碼,Codex 接受了數十億行公共程式碼的訓練,但研究人員表示,與對照組相比,透過Codex寫出的程式碼更「不安全」,而使用此系統的人卻對Codex相當信任,這引發了他們的擔憂。

研究人員Megha Srivastava表示,他們的研究並非要譴責Codex 和其他程式碼生成系統,寫程式的人員也應該要有能發現程式碼漏洞的安全專業知識。 除此之外,Srivastava 認為,對於風險不高的任務,程式碼生成系統確實有很大的助益,但製作此系統的公司必須更小心謹慎。

研究人員表示,開發商可以透過「改進」用戶提示以提高安全性,類似於有一個「主管」專門檢查和修改程式碼草稿,同時,開發人員也應該確保他們的默認設置是安全的。

然而,安全漏洞並不是程式碼生成 AI 系統的唯一缺陷。基於程式碼生成系統裡面有些範例程式碼是來自某些出版書籍,一些法律專家認為,如果公司和開發人員無意中將該工具中受版權保護的建議整合到他們的生產軟體中,程式碼生成系統就可能會使公司和開發人員面臨法律風險。

雖然GitHub推出了一個過濾器試圖解決這個問題,但是成效不佳。德州農工大學電腦科學教授Tim Davis就發現,啟用過濾器會導致由Codex 提供支持的Copilot 發出大量受版權保護的程式碼。因此,Srivastava表示,對於程式碼生成工具的使用與教育仍須非常謹慎。

參考資料:TechCrunch

瀏覽 907 次