Google機器人加入AI能力 可聽懂自然語言指令

Google近日在AI大會上展示了可為機器人加入AI能力,使機器人能為自己寫程式,不必再透過大量資料訓練,不過該系統還無法處理抽象、複雜的指令,或理解較複雜的描述。目前Google已經將程式碼及技術白皮書公開在GitHub上。

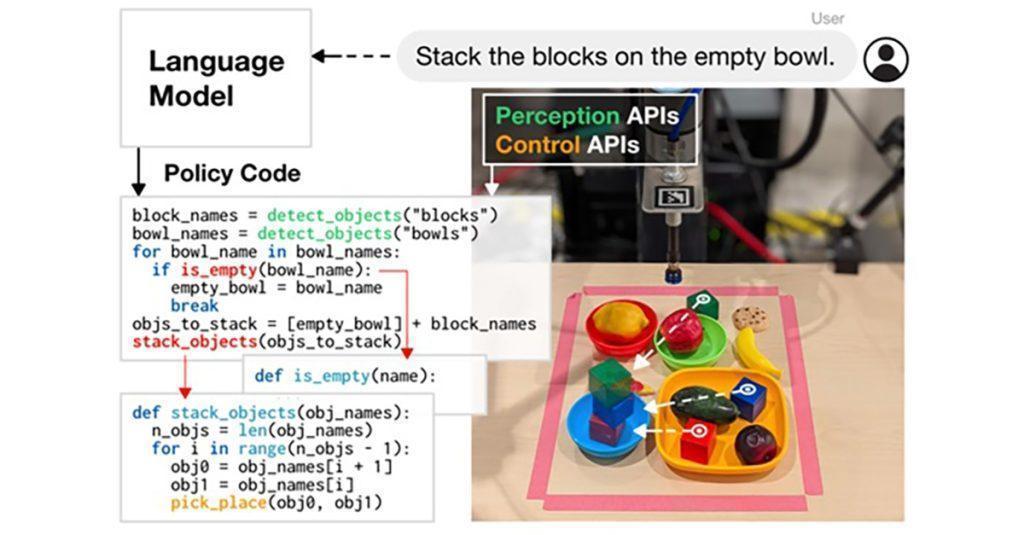

現代AI語言模型已越來越強大,Google今年初發表的PaLM具備複雜的理解能力,這類的語言模型以數百萬程式訓練而成,只要給出適當自然語言指令,模型就能撰寫泛型程式,還能寫出控制機器人行為的程式碼。為了實現這個概念,Google開發了Code as Policies(CaP),這是一款將語言模型產生的程式,以實體機器人實作執行。

CaP是Google之前開發的幫手機器人模型PaLM-SayCan的延伸,希望使用者以Python通用語言運用少量、簡單的說明,就能讓語言模型撰寫機器人程式碼,讓機器人精準執行,最終的目的是希望可以在可讓單一系統執行多種複雜任務,而不再需要特別的訓練。

相關研究人員解釋,CaP是使用一種程式碼撰寫模型,提供了暗示(告知它有哪些API)及範例(命令該如何轉成程式碼)後,就能為新命令撰寫新程式碼,且可將概括化結果輸入到有知覺控制的系統,不需要像傳統機器人學習過程中蒐集大量資料才能學習。此外,還能將精準的值翻譯成模糊描述,並套用其他語言模型,如支援非英語及emoj的指令。

目前Google的CaP機器人可以執行簡單的任務,研究人員指出,這項系統還無法處理抽象、複雜指令,或是理解較複雜的描述。Google已經將CaP的程式碼及技術白皮書公開在GitHub上。(記者/竹二)

瀏覽 836 次