Meta推出Code Llama語言模型 程式開發能力優

記者/竹二

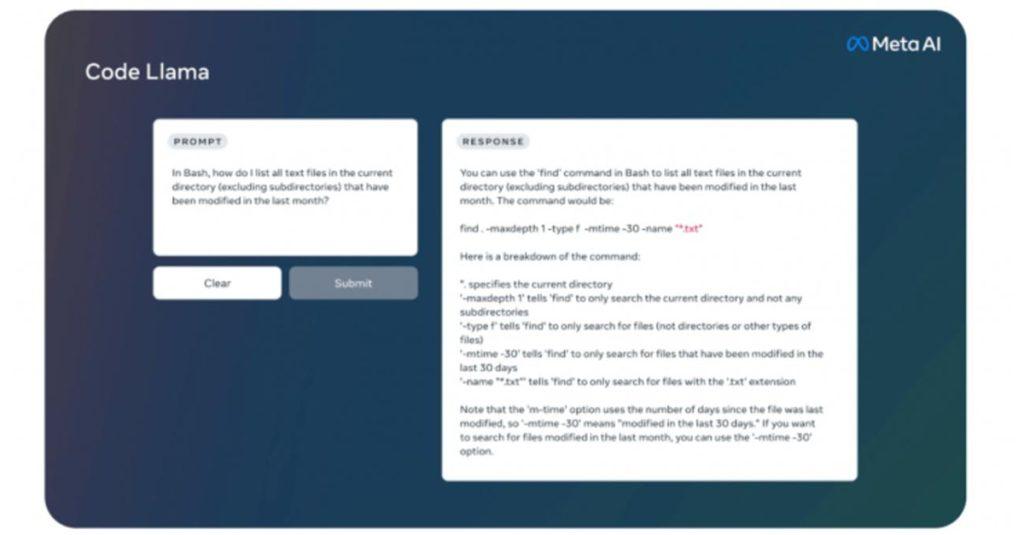

Meta近日推出程式開發用的語言模型Code Llama,這是基於之前所發布的可商用大型語言模型Llama 2做為基礎所開發,根據Python與自然語言的需求,還提供額外2種變體,並有70億、130億和340億參數3種大小可供選擇。

Code Llama支援7種程式語言,有3種大小模型

Code Llama是使用更多程式碼資料集訓練,並從該資料集截取更多資料後,進行長時間的訓練而成,是專門處理程式碼的Llama 2模型,因此Code Llama具有更強的程式碼編寫能力,可以根據程式以及自然語言提示,生成程式碼,或是有關程式碼的自然語言回應,執行程式碼完成和除錯任務,支援的程式語言有Python、C++、Java、PHP、Typescript、C#以及Bash。

更多新聞:Meta釋出新AI模型 可翻譯語音、文字100種語言

Meta也根據不同的服務和延遲需求,推出3種大小的Code Llama模型,分別是70億、130億與340億參數,70億參數的版本可以在單一個GPU上運作,最大的340億模型則是能夠回傳最佳結果,因此使用者可以依據需求選擇不同大小的模型。

Code Llama可處理長序列內容,程式開發能力優

此外,Code Llama具有處理長序列內容的能力,可以穩定生成10萬Token的內容,並處理高達10萬Token的輸入,在處理長輸入序列時還能夠支援更多的使用情境,像是使用者可以提供更多來自程式碼庫的上下文,並對更大的程式碼進行除錯。

經過Meta的測試後發現,Code Llama程式開發的能力優於其他開源版本,針對程式碼生成的大型語言模型,Code Llama 340億參數模型版本在HumanEval得分53.7%,而在MBPP的得分則是56.2%,確實較其他開源解決方案更高。

瀏覽 672 次