AI什麼不該做 歐盟要求業界提意見

編譯/夏洛特

歐盟正積極推動人工智慧(AI)監管政策,並於近期完成《AI法案》最後草案。為使規範更完善,歐盟更是於近日展開一項公開諮詢,希望透過此諮詢明確界定什麼樣的軟體可被稱為「AI」,以在AI系統與較為簡單的軟體間劃出明確界線,進一步優化定義,防止過度約束基礎應用,並保護公眾安全。

AI系統定義:廣邀產業意見

據報導,歐盟這項諮詢聚焦於兩大範疇,首先是針對「AI系統」的定義。歐盟希望透過徵詢AI產業、商業界、學術界和民間社會的意見,來確保法案關鍵定義的清晰性,並收集具體的軟體案例,以界定何者應排除在法案範疇之外。

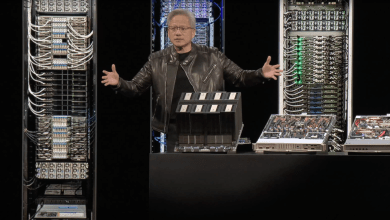

更多新聞:輝達黃仁勳提出「AI 陰暗面」警告 籲美國政府要監管

AI禁用情境:尋求實際案例意見

另一大重點則是AI的「禁用用途」。新法案中列出了被視為「不可接受風險」的使用情境,如部分高風險使用情境如中國社會信用體系已被禁止,這類系統被視為人權威脅,可能侵犯隱私或限制自由。藉此諮詢,歐盟希望能廣泛蒐集各界對禁用用途的意見,並獲得有關實際案例的回饋,以便在未來的指導中進一步細化條文。

*中國的社會信用體系是一個由政府推動的國家級信譽管理系統,旨在根據個人、企業和政府的行為來評估和記錄其社會信用,如,若一個人因為小額未繳的債務或輕微的違法行為而被評為低信用分數,可能會影響其日常生活和基本權利。

對企業、公民與AI開發者的影響

- 對企業而言,該法案可能要求調整AI產品的設計與銷售方式,某些功能可能需修改或刪除以符合禁用類別,雖然可能增加符合規定的成本,但也推動了透明和負責任的開發方向。

- 而對普通公民來說,法案則提供更強的隱私與自由保障,透過管制高風險AI用途,歐盟致力於保護公民免受數據濫用或潛在偏見的影響。

- 對AI開發者來說,法案強調需更加注重倫理和隱私標準,此負責的AI發展方向可能啟發出更多創新、安全的解決方案。

邁向更安全的 AI 監管未來

此次諮詢期將持續至2024年12月11日,歐盟會在此後分析回饋意見,最終指導文件預計於2025年初發布,以進一步明確AI系統的定義及禁用用途規範。

參考資料:Tech Crunch、autogpt

※探索職場,透視薪資行情,請參考【科技類-職缺百科】幫助你找到最適合的舞台!

瀏覽 817 次