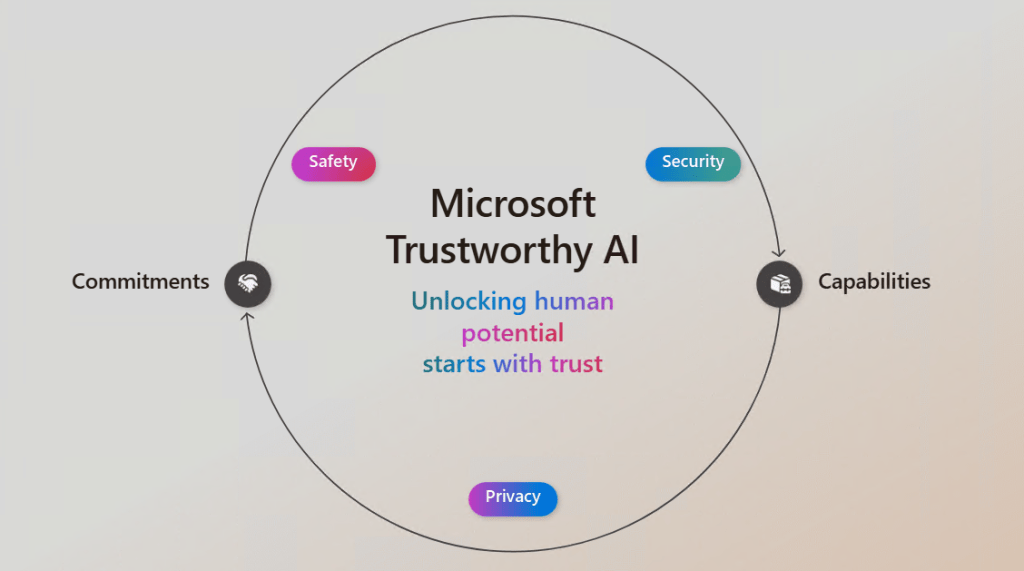

微軟推出「可信任AI計畫」 強化安全性與隱私保護

記者/彭夢竺

微軟近日宣布可信任AI計畫Trustworthy AI,推出全新的相關產品功能及服務,進一步強化AI服務的全面性防護措施,協助客戶使用並建構值得信任的人工智慧,確保其AI受到保護、並具備安全性及隱私性。

微軟安全未來倡議計畫再推2功能

在安全保護部分,微軟擴展的「安全未來倡議計劃」(SFI)強調公司全體上下對客戶的安全承諾,除了Microsoft Defender和Purview外,AI服務也內建基本的安全控制功能,防止提示詞被截取(prompt injections)和版權侵犯,再宣布推出2項新功能,Azure AI Studio中的Evaluations功能已支援主動式的風險評估,以及Microsoft 365 Copilot將提供網路查詢的透明度,協助管理員和用戶了解網路搜尋如何改善Copilot的回應。

延伸閱讀:微星參加台灣人工智慧年會 展示AI技術創新應用成果

微軟負責任AI推出全新產品功能

安全性方面,微軟2018年建立「負責任AI原則」,安全的構建和部署AI服務,包含建立、測試和監控系統,以防止有害內容、偏見及其他風險,微軟也在治理結構、政策、工具和流程方面進行了重大投資,確保這些準則的落實,為了幫助客戶在追求AI帶來的利益同時能夠降低相關風險,推出全新產品功能,包含在Microsoft Azure AI Content Safety中的Groundedness檢測功能中新增矯正功能、Embedded Content Safety允許客戶將Azure AI Content Safety功能嵌入到裝置設備中。

還有Azure AI Studio推出新的評估功能,可協助客戶評估輸出內容的品質和關聯性,並檢測AI應用輸出受保護的資料的頻率。此外,在Azure AI Content Safety中的Protected Material Detection for Code功能目前正在預覽中,有助於偵測預先存在的內容和程式代碼,能幫助開發者探索GitHub儲存庫中的公開原始碼,促進協作和透明度,進而做出更明智的編碼決策。

微軟全球執行副總裁暨首席行銷長沼本健(Takeshi Numoto)指出,他們承諾持續精進技術與能力,確保客戶和開發者在每一層面的AI應用都得到充分保護,這些全新產品功能,可以加強AI系統的保障、安全及私隱保護。

※探索職場,透視薪資行情,請參考【科技類-職缺百科】幫助你找到最適合的舞台!

瀏覽 147 次